Riorganizzazione dell’esperienza dei clienti aziendali per la generazione di MCP

Le regole dell’IA vengono riscritte daccapo quasi ogni giorno. Le persone e i brand si stanno affrettando a definire cosa significhi l’IA e come farla funzionare, ma una sola domanda è al di sopra di tutto: chi controllerà il futuro delle esperienze dei tuoi clienti e dipendenti, tu o i tuoi fornitori? Avaya crede che la risposta sia tu. Ecco perché stiamo scommettendo sul futuro aperto dell’IA, costruendo la piattaforma Avaya Infinity per supportare il Model Context Protocol (MCP). È la mossa giusta: per i nostri clienti, per il mercato e per il tipo di fiducia e innovazione che definiranno cosa succederà sia alle imprese private e sia agli enti pubblici.

Cos’è MCP?

MCP è l’acronimo di Model Context Protocol, uno standard aperto emergente che consente ai modelli IA (come GPT, Claude o Gemini), di interagire in modo sicuro e affidabile con strumenti esterni, fonti di dati, API e contesti utente in modo molto più strutturato. Consente all’IA di operare con memoria, pertinenza e continuità, non in modo isolato, ma in sincronia con il contesto aziendale, la cronologia degli utenti e l’intento operativo. MCP rende l’IA infinitamente utile in ambienti ad alta sensibilità e su larga scala.

“Questo non il momento di aspettare. Per Avaya questo è il momento giusto di agire con decisione per costruire il motore di orchestrazione aperta definitivo per l’impresa moderna”.

David Funck, Chief Technology Officer, Avaya

Come funziona MCP?

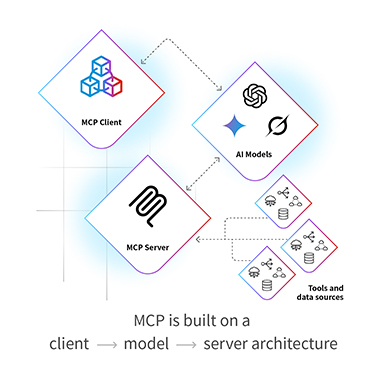

MCP è realizzato su una struttura client → modello → architettura server:

- Il client raccoglie il contesto, ossia informazioni utente, ruolo, attività, ambiente.

- Il modello, ad esempio, Claude o GPT, riceve il contesto e un elenco di strumenti o azioni disponibili.

- Il server ospita gli strumenti, come API, database, ecc. ed esegue tutte le azioni richieste dal modello.

Tutte le comunicazioni seguono schemi strutturati affinché sia tutto interpretabile, tracciabile e sicuro.

Avaya Infinity: dai moonshot a MCP

Dialogo one-on-one con Patrick Dennis - CEO di Avaya e David Funck - CTO di Avaya.

Eliminare l’attrito con l’IA e l’MCP

Per troppo tempo, integrare l’IA nell’esperienza del cliente ha significato scegliere il minore dei due mali:

- Rimanere bloccati con l’ecosistema chiuso di un singolo fornitore, sacrificando flessibilità e future opzioni

- Orientarsi nel caos di integrazioni frammentate, costose e una tantum, con molteplici strumenti e silos di dati

Questa falsa scelta limitava l’innovazione e gravava sui team IT. Creava esperienze frammentate che corrodevano la fiducia, sia con i clienti che con i dipendenti. In un mondo che si muove alla velocità dell’IA, questo approccio è semplicemente insostenibile.

Inserisci l’ MCP: lo standard aperto e indipendente dal fornitore che cambia tutto. Con l’MCP i modelli di IA possono interagire perfettamente con strumenti, dati e logica operativa, in modo sicuro e su larga scala. La metafora preferita dai pochi che si esprimono su questo argomento è quella di considerarlo come l’USB-C per l’IA: un connettore universale che funziona su modelli, piattaforme e sistemi aziendali.

Creato e pubblicato da Anthropic alla fine del 2024. La rapida adozione di MCP da parte di importanti operatori tecnologici come OpenAI, Google DeepMind e Microsoft sottolinea la sua importanza strategica. Questo allineamento nella scelta indica la consapevolezza collettiva di come le integrazioni proprietarie ostacolino la crescita del mercato più di qualsiasi vantaggio acquisito con gli ecosistemi chiusi. Stiamo assistendo e co-creando un cambiamento fondamentale verso l’interoperabilità, la trasparenza e il controllo degli utenti.

MCP consente ai sistemi di IA di operare con una consapevolezza dinamica dell’utente, della sessione e del contesto aziendale. Per Avaya Infinity questo significa che i modelli possono fornire costantemente risposte accurate, ma anche pertinenti, personalizzate e on-brand, anche in ecosistemi frammentati e su scala aziendale. Questo livello di intelligenza contestuale è fondamentale per le organizzazioni che gestiscono migliaia di flussi di lavoro, utenti e punti di integrazione tra le operazioni.

Collaborazione con Databricks

Nell’ambito del nostro impegno per un’IA sicura, scalabile e aperta, collaboriamo con Databricks per portare la governance e la privacy dei dati di livello aziendale nell’implementazione MCP all’interno della piattaforma Avaya Infinity. Questa collaborazione garantisce che i clienti aziendali possano implementare con sicurezza strumenti di IA con controllo degli accessi molto granulari, registrazione degli audit e integrazioni senza interruzioni tra fonti di dati strutturati e non strutturati.

“L’IA generativa offre un enorme potenziale per trasformare le esperienze dei clienti, quindi siamo entusiasti di collaborare con Avaya per aiutare le organizzazioni a unificare rapidamente i propri dati, semplificare la governance e la sicurezza dei dati e dell’IA e, infine, fornire un’intelligenza artificiale che comprenda il loro business”.

Heather Akuiyibo, VP of GTM Integration, Databricks

Dal frammentazione alla libertà con MCP

In un’azienda standard ci sono un numero “N” di strumenti e di fonti dati (ad esempio Salesforce, un database di prodotti, una knowledge base) e un numero "M" di modelli o applicazioni di IA che devono accedervi. Prima di MCP, collegare ogni strumento a ciascun modello di IA richiedeva un’integrazione punto a punto univoca. Ciò ha creato un’esplosione combinatoria di lavoro di sviluppo, con conseguente architettura che era costosa da costruire, difficile da mantenere e intrinsecamente difficilmente scalabile.

MCP trasforma questo paradigma introducendo un livello intermedio standardizzato, convertendo il complesso problema N x M in una soluzione "N + M" semplice e scalabile. Ciascuno degli strumenti ’N’ deve essere avvolto solo con un singolo server MCP, e ciascuno dei modelli di IA ’M’ ha bisogno solo di un singolo client MCP. Una volta che un componente può “parlare” il linguaggio MCP, è in grado di comunicare con qualsiasi altro componente conforme a MCP nell’ecosistema. Questo riduce drasticamente le spese generali di sviluppo, elimina il lavoro ridondante e sradica il debito tecnico associato al mantenimento di decine di connettori vulnerabili e dedicati. Gli investimenti in nuove tecnologie, canali e modalità volti a unificare le interazioni con i clienti spesso li frammentano. I clienti finiscono per sentire che le aziende con cui si interfacciano non li conoscono veramente, si occupano meno di loro e prestano loro meno attenzione, di quanto mai fatto prima d’ora. Per molte organizzazioni, questa carenza è maggiormente percepibile nei contact center.

Avaya sta cambiando questa tendenza, unificando l’esperienza frammentata del contact center. Collegando i canali, le informazioni, le tecnologie e i flussi di lavoro che aiutano a fornire interazioni di qualità.

Il ROI potenziale di MCP

Con MCP gli utenti di Avaya Infinity realizzeranno un valore aziendale ancora più rilevante: tempi di risoluzione più rapidi, conversazioni più naturali, maggiore coerenza del brand e maggiore soddisfazione nelle interazioni con clienti e dipendenti. Sblocca un nuovo livello di prestazioni nell’IA generativa, in cui gli output non sono solo intelligenti, ma sono consapevoli del contesto e sono strategicamente allineati.

Le prime ricerche suggeriscono che MCP produrrà notevoli miglioramenti per le imprese, consentendo loro di risparmiare tempo e denaro in diversi ambiti:

| Prima di MCP | Dopo MCP | |

| Integrazione | Connettori personalizzati per modello/strumento | Un'unica interfaccia MCP funziona su tutti i modelli e strumenti |

| Tempo di implementazione | Lungo e costoso a causa della progettazione su misura | 50-70% più veloce, costi inferiori grazie al riutilizzo (quiq.com, Palma AI, Humanloop, aibase.com) |

| Accesso ai dati | AI cieca ai dati di sistema, contesto perso | Contesto completo in tempo reale: CMS, CRM, EHR, ERP |

| Gestione dei rischi | Ricerca manuale, rilevamento delle frodi ritardato | I controlli incrociati istantanei tra i sistemi riducono le frodi del 30% |

Il futuro è aperto

I leader dell’IA più influenti del mondo si stanno allineando su MCP perché riconoscono che il futuro dell’IA è aperto e contestuale e che il suo potenziale è quasi impossibile da sovrastimare. Convinti e consapevoli della nostra strategia verso un'orchestrazione aperta e intelligente, in Avaya siamo orgogliosi di guidare questo cambiamento, portando MCP nel mondo dell’esperienza cliente.

Glossario

Glossario completo dei termini riportato di seguito.

| Termine | Definizione | Perché è importante |

| MCP (Model Context Protocol) | Un protocollo aperto che standardizza il modo in cui i modelli di IA interagiscono con strumenti, API e memoria tramite oggetti contestuali strutturati. | Consente un comportamento dell'IA affidabile, interpretabile e scalabile in tutti i flussi di lavoro e i sistemi aziendali. |

| Contesto | Un insieme di informazioni strutturate trasmesse a un modello, quali ID utente, cronologia delle sessioni, ruoli, ora o disponibilità degli strumenti. | Consente ai modelli di generare risposte pertinenti, personalizzate e contestualizzate. |

| Modello | L'IA generativa (ad esempio Claude, GPT-4, Gemini) che riceve il contesto MCP e genera risposte. | Il “cervello” nel ciclo, che utilizza il contesto per prendere decisioni più intelligenti e più allineate. |

| Client | L'applicazione o l'interfaccia (ad esempio, finestra di chat, framework dell'agente, portale clienti) che raccoglie e invia il contesto al modello. | Il punto di accesso rivolto all'utente che avvia le richieste e le interazioni. |

| Server | Il livello logico che ospita strumenti, API, funzioni e fonti di dati che il modello può utilizzare tramite MCP. | Il backend di esecuzione delle azioni, che garantisce che i risultati dell'IA possano attivare azioni aziendali nel mondo reale. |

| Strumenti | Funzioni discrete o API (ad esempio, “cerca nella knowledge base”, “controlla lo stato del ticket”, “aggiorna CRM”) esposte al modello tramite MCP. | Consentono ai modelli di andare oltre il linguaggio e di intraprendere azioni su sistemi esterni. |

| Schemi | Le definizioni strutturate (in JSON o YAML) relative alla modalità di rappresentazione e trasmissione degli strumenti e del contesto ai modelli. | Creare un linguaggio comune tra client, server e modello, migliorando la coerenza e il debug. |

| Memoria | Contesto persistente mantenuto tra le sessioni (cronologia dell'utente, preferenze, azioni passate) fornito al modello. | Consente continuità e personalizzazione nel tempo, come un agente che “ricorda” un cliente. |

| Contesto effimero | Informazioni di breve durata, specifiche della sessione (ad esempio, attività corrente, variabili temporanee). | Mantiene le risposte dell'IA mirate ed efficienti solo per l'interazione corrente. |

| Agente | Un sistema di intelligenza artificiale in grado di intraprendere azioni, richiamare strumenti e prendere decisioni in base al contesto MCP, spesso utilizzato in flussi di lavoro autonomi o semi-autonomi. | MCP fornisce la struttura portante per consentire un comportamento sicuro, utile e controllabile dell'agente. |

| Orchestrazione | Coordinamento di più fasi, strumenti e risultati dei modelli per raggiungere un obiettivo aziendale di ordine superiore. | MCP semplifica l'orchestrazione fornendo ai modelli l'accesso a un contesto strutturato e a strumenti in un unico protocollo. |

| Osservabilità | La capacità di verificare quale contesto è stato trasmesso, quali decisioni ha preso il modello e come sono stati utilizzati gli strumenti. | Fondamentale per il debug, la conformità e la fiducia delle aziende nei sistemi di IA. |

| Interoperabilità | La capacità di diversi modelli e piattaforme di IA di funzionare con una struttura condivisa di strumenti e contesti. | MCP consente l'IA plug-and-play tra diversi fornitori e architetture. |